Cos’è l’HDR, a cosa serve e quale tra le varianti a mercato è quella su cui puntare maggiormente acquistando un tv 4K

HDR sta per High Dynamic Range, termine ormai in uso da tempo anche in campo fotografico, ma quando si parla di video HDR si tratta di metadati. I metadati HDR sono informazioni supplementari inviate col segnale video, che indicano al tv o videoproiettore come visualizzare correttamente il contenuto. Tali metadati sono gestiti in misura diversa attraverso gli standard: HLG, HDR-10, HDR-10+ e Dolby Vision. La compatibilità dev’essere totale anche per il resto della catena digitale: nel caso di dischi fisici oltre a tv/vpr sono inclusi player Blu-ray 4K e cavo HDMI, tutti devono essere in grado di far transitare correttamente il segnale video.

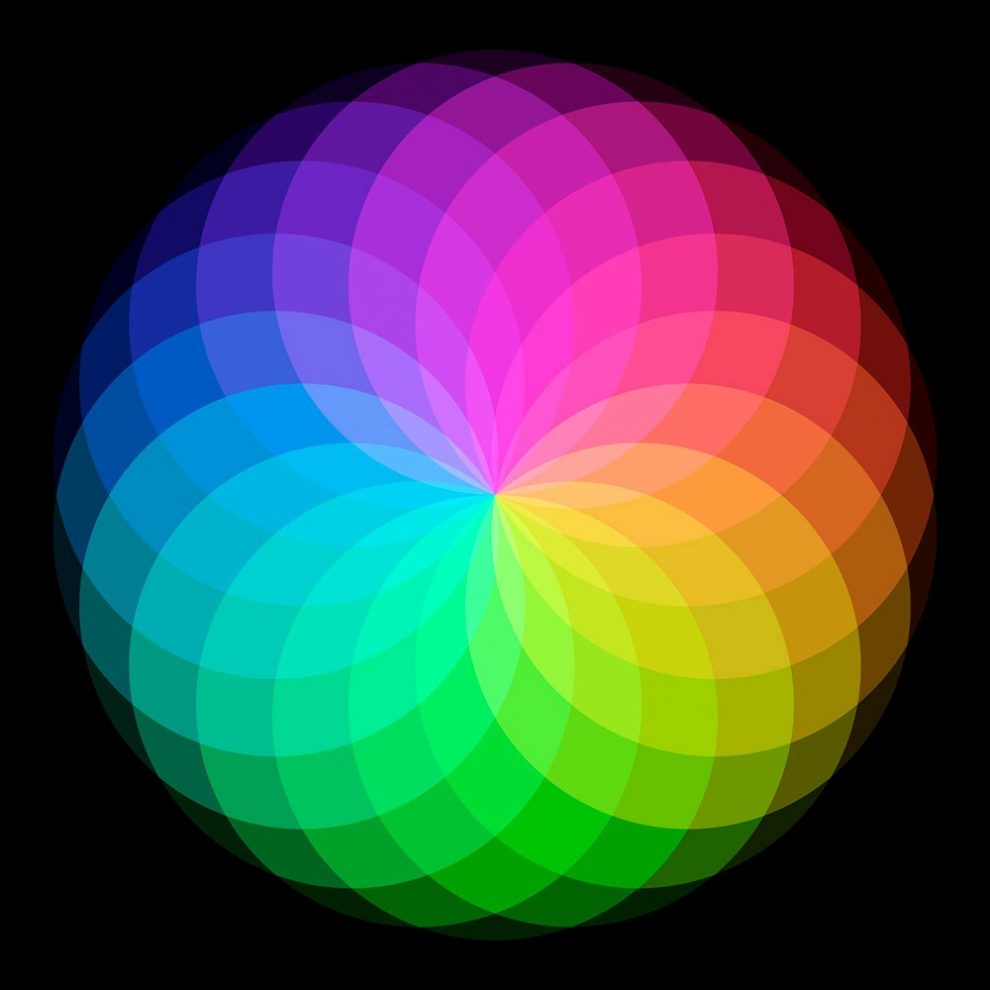

In virtù dell’HDR c’è una maggiore estensione dinamica, dove per gamma dinamica s’intende l’intervallo dinamico tra le sezioni più chiare e quelle più scure dell’immagine che il dispositivo può riprodurre. Grazie all’HDR è possibile avvicinarsi maggiormente alla rappresentazione della realtà, con inferiore grado di compressione dinamica. In teoria è possibile cogliere la gamma dinamica da 0,00005 a 10.000 cd/m2, ma i tv e i vpr al momento non si comportano altrettanto bene, con livelli che vanno da 0,005 e 1000 cd/m2. Ciò non di meno grazie all’HDR è stato possibile aumentare il grado di realismo, ed è qui che l’hardware di fascia alta consente di produrre una più elevata gamma di colori aumentando la luminosità massima raggiungibile e la differenziazione dei punti luce, avvicinandosi a quanto pensato dai creativi.

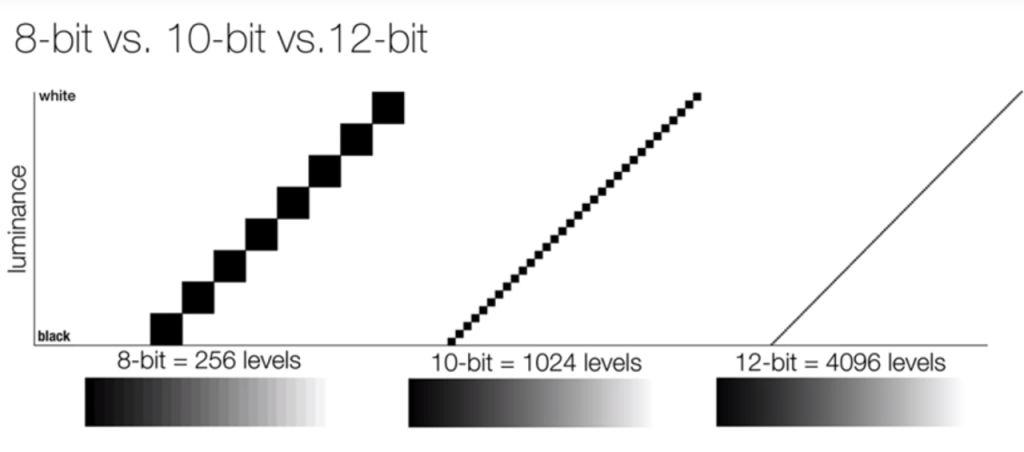

Tutto questo sempre e comunque se il pannello è effettivamente 10 bit, in grado quindi di gestire al meglio la maggiore ampiezza cromatica. Televisori 4K HDR sono ampiamente diffusi, ma non tutti dispongono di pannelli 10 bit, quelli più economici offrono ancora 8 bit oppure la variante migliorativa che inganna occhio e cervello, ovvero l’8+FRC (che in misura un po’ azzardata viene definito 10 bit, quando ne è invece una sorta di surrogato). I 10 bit sono essenziali per mostrare tutte le sfumature cromatiche possibili insite in particolare nei segnali video a metadati dinamici, ovvero HDR-10+ e Dolby Vision.

Quando si sceglie un nuovo televisore sarebbe opportuno accertarsi del numero di bit (informazione in genere ben poco diffusa), specie se si desidera sfruttare l’intero comparto HDR. Se per esempio ci si trovasse nella condizione di un tv che offre anche HDR-10+ e/o Dolby Vision ma il pannello fosse solo 8+FRC rimarrebbe il rischio di accorgersi di banding e crash colori in secondo piano, vanificando la qualità della fonte video 4K. Disponendo di pregiato materiale fisico a metadati dinamici o desiderosi di sfruttare la sempre più ampia offerta liquida va da se che occorre prestare attenzione a tali compatibilità. Con l’aumentare dei bit per pixel aumentano le tonalità di colore (vedi immagine qui sotto).

La profondità in bit descrive la quantità di possibili gradazioni cromatiche in un’immagine. Il contenuto SDR è in genere a 8 bit, e quindi offre una varietà di soli 16,7 milioni di colori, l’HDR beneficia di masterizzazione a 10 bit (e qui sta il vero salto di qualità tra materiale 2K/SDR e 4K/HDR), e quindi 1,07 miliardi di colori. In tal senso più colori, più realistica l’immagine e più elevato il volume di sfumature per colori simili. Rispetto ad HDR-10 e HDR-10+ che viaggiano a 10 bit, il Dolby Vision consente colori fino a 12 bit: differenza (teoricamente) abissale che passa gli 1,07 miliardi di colori dei 10 bit ai 68,7 miliardi di colori a 12 bit e ulteriore precisione ed estensione colorimetrica. Peccato però che al momento non esistano pannelli 12 bit nativi per uso consumer e che quindi non sia realmente sfruttabile.

La luminanza di una superficie infinitesima in una data direzione è definita come rapporto tra l’intensità luminosa emessa in tale direzione e l’area apparente della superficie verso chi osserva; per inciso l’area apparente è la proiezione della superficie nella direzione dell’osservatore. In termini di luminanza massima la maggior parte dei contenuti Dolby Vision è attualmente masterizzata a 4.000 cd/m2 ma potrebbe raggiungere i 10.000 cd/m2, mentre i contenuti HDR10 e HDR-10 + in base allo specifico programma sono masterizzati con una luminanza variabile tra le 1.000 e un massimo di 4.000 candele per metro quadro. La differenza non è al momento così palpabile, dato che nessuno degli standard va oltre le 4000 cd/m2, peraltro valore irraggiungibile da uno schermo. Se ne riparlerà quando esisteranno pannelli realmente capaci di raggiungere 4000 cd/m2, sperando in tecnologie che non implichino un inverosimile carico di LED che oltre a scaldare inciderebbero pesantemente sul costo energetico. Stesso discorso vale per la tecnologia OLED, che se si alzasse la soglia di luminanza si andrebbe a comprometterne la durata nel tempo.

Quando la tv non è capace di mostrare elementi oltre le 1000 cd/m2, cosa accade con materiale video masterizzato oltre tale valore? Ciò che il pannello non può mostrare viene scartato applicando il cosiddetto ‘clipping’, ovvero scomparirebbe qualsiasi tipo di dettaglio in tale gamma di luminosità e in egual misura non sarebbe possibile distinguere i colori. L’alternativa è il ‘tone mapping’. In tal caso quanto presente oltre i 1.000 cd/m2 viene rimappato al di sotto di tale valore massimo, provocando una lieve variazione di colore nelle alte luci, non molto al di sotto, ma ottenendo al tempo stesso più dettagli alle alte luci di quanto non sia possibile con il clipping. In tal senso per HDR-10 e HDR-10+ il tone mapping è strettamente legato al produttore dei tv e non sempre garantisce la giusta efficacia. Per contro col Dolby Vision la mappatura è proprietaria, un tempo via chip ora via software, e meno a rischio incoerenza.

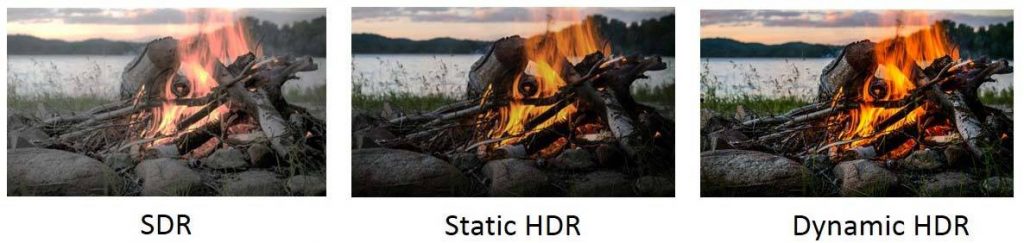

Quanto ai metadati, ovvero le informazioni che contribuiscono a descrivere il contenuto del materiale video, relativi a programmi HDR ce ne sono di tipo statico, ancora oggi purtroppo i più diffusi, e poi quelli di tipo dinamico ovvero per programmi HDR-10+ e Dolby Vision. Con i metadati statici i limiti di luminosità vengono impostati una sola volta per l’intero programma, regolazione che parte esaminando unicamente la scena col picco massimo. In caso di metadati dinamici il tone mapping occorre ripetutamente all’interno del programma, in genere al cambio di una scena e quindi delle diverse condizioni di illuminazione e quindi maggiore fedeltà.

Come HDR c’è anche il poco nominato HLG (Hybrid Log Gamma), comunque presente nella stragrande maggioranza di tv e videoproiettori, combinando SDR e HDR in un solo segnale. Pensato per le trasmissioni televisive in diretta può venire riprodotto da qualsiasi pannello sia SDR che HDR. Tirando le somme il più diffuso e anche il meno performante è l’HDR-10, con un sempre più elevato volume di programmi sia su fisico che in streaming. Le attuali prestazioni e limiti più o meno imposti rendono per ora similari HDR-10+ e Dolby Vision, in misura non dissimile da quanto accaduto nelle precedenti “guerre dei formati” entrambi cercano la più elevata diffusione possibile su hardware e software.

Il Dolby Vision è senza dubbio il formato HDR più avanzato dal punto di vista tecnico, già migliorato nel tempo dovrebbe essere sempre presente (proprio come l’HDR-10+) quando il pannello è 10 bit reali, anche se per ora a livello di contenuti la domanda è relativamente soddisfatta. A esaltare le differenze di tutti questi standard ci sono in minima parte i videoproiettori (al momento privi di gestione a metadati dinamici) ma soprattutto i televisori. Questi ultimi davvero in grado di mostrare differenze SDR/HDR davvero significative sono i pannelli alto di gamma, in attesa che le rivoluzioni tecnologiche prossime future aprano la strada a un ulteriore passo avanti verso un sempre maggiore fotorealismo.

© 2021, MBEditore – TPFF srl. Riproduzione riservata.